Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

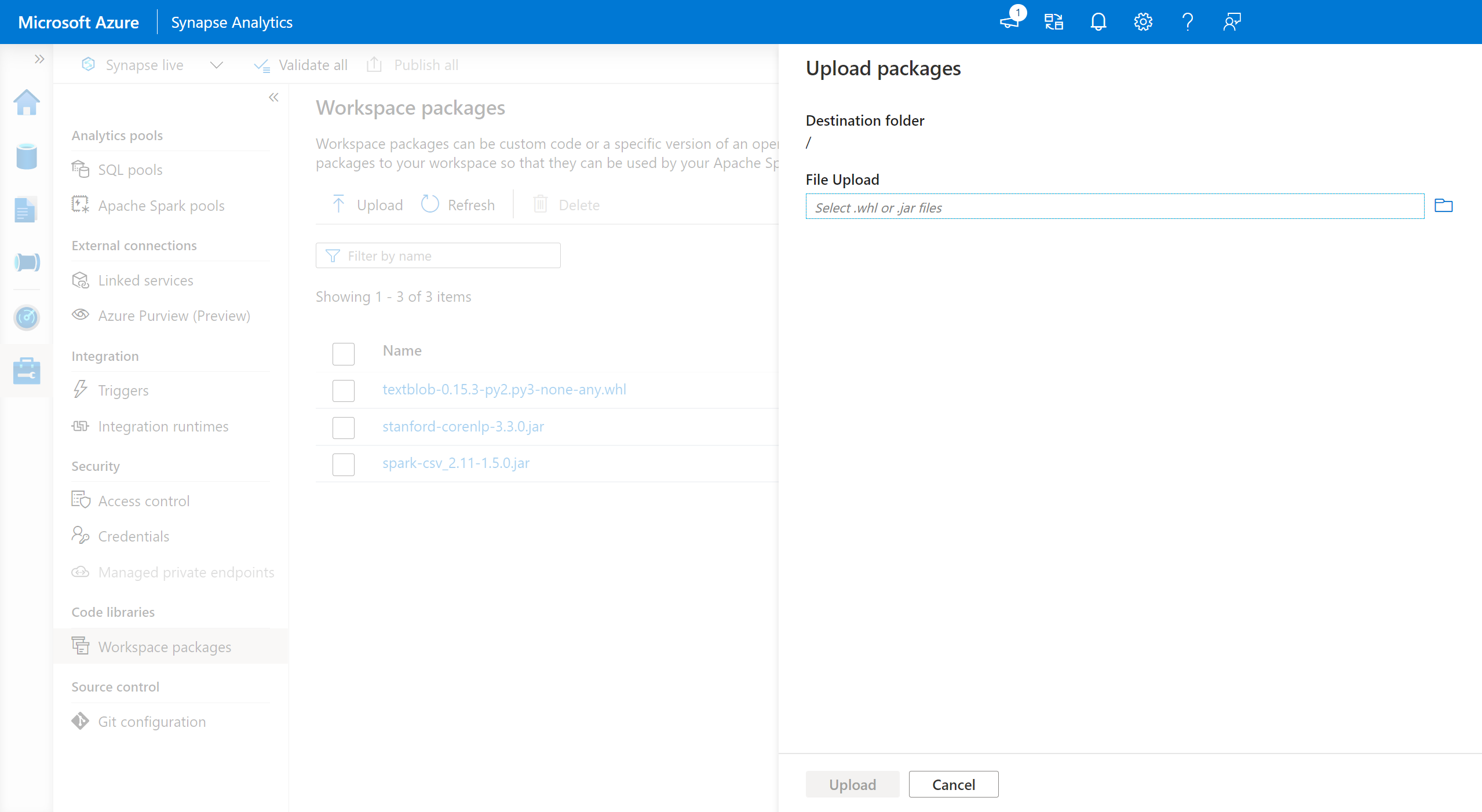

工作区包可以是自定义或专用滚轮(Python)、jar(Scala/Java)或tar.gz(R)文件。 可将这些包上传到工作区,然后再将其分配到特定的 Spark 池。

添加工作空间包:

- 导航到

管理 工作区包 选项卡。 - 使用文件选择器上传文件。

- 将文件上传到Azure Synapse工作区后,可以将这些包添加到 Apache Spark 池。

警告

在Azure Synapse中,Apache Spark 池可以利用作为工作区包上传或在已知Azure Data Lake Storage路径中上传的自定义库。 但在同一 Apache Spark 池内不能同时使用这两种选项。 如果使用两种方法提供包,则只会安装在工作区包列表中指定的 wheel 文件。

在给定的 Apache Spark 池中使用工作区包来安装包后,就不能再在同一池中使用存储账户路径来指定包。

注意

建议在工作区中不要有多个同名的包。 如果要使用同一个包的不同版本,则必须删除现有版本并上传新版本。

存储帐户

通过将所有文件上传到与 Synapse 工作区链接的 Azure Data Lake Storage (Gen2) 帐户,即可在 Apache Spark 池上安装自定义生成的包。

应将这些文件上传到存储帐户默认容器中的以下路径:

abfss://<file_system>@<account_name>.dfs.core.chinacloudapi.cn/synapse/workspaces/<workspace_name>/sparkpools/<pool_name>/libraries/python/

警告

- 某些情况下,如果文件路径不存在,则可能需要根据上面的结构创建文件路径。 例如,可能需要

python文件夹中添加libraries文件夹(如果该文件夹不存在)。 - Apache Spark 3.0 的 Azure Synapse 运行时不支持管理自定义文件的方法。 请参阅工作区包功能以管理自定义文件。

重要

若要使用 Azure DataLake 存储方法安装自定义库,必须具有 Storage Blob 数据参与者或 Storage Blob 数据所有者与Azure Synapse Analytics工作区链接的主 Gen2 存储帐户的权限。

后续步骤

- 查看默认库:Apache Spark 版本支持

- 排查库安装错误:排查库错误

- 使用 Azure Data Lake Storage 帐户创建专用 Conda 频道:Conda 专用频道